TL;DR – La CIA vous résume

L’intelligence artificielle est déjà partout dans les entreprises, souvent sans cadre clair.

L’AI Act européen ne vise pas à freiner l’innovation, mais à classer les usages de l’IA par niveau de risque pour éviter les dérives là où les décisions ont un impact réel sur les personnes (emploi, crédit, santé).

👉 Ce n’est pas l’outil IA qui est jugé, mais l’usage que vous en faites.

👉 La majorité des entreprises ne sont pas en infraction, mais manquent de visibilité sur leurs usages.

👉 Les tensions avec les États-Unis relèvent d’une bataille de standards, pas d’un rejet de l’IA.

👉 Le vrai risque pour l’emploi n’est pas l’automatisation, mais l’absence de formation et de gouvernance.

À retenir côté action :

Lister vos outils IA, identifier les usages sensibles, garder un humain responsable dans la boucle et former vos équipes suffit déjà à être conforme et compétitif.

Conclusion CIA :

L’IA n’est pas dangereuse.

👉 L’improvisation, oui.

Comprendre l’AI Act sans jargon (et sans maux de tête)

L’intelligence artificielle n’est plus un gadget réservé aux ingénieurs en sweat à capuche ou aux labos californiens.

Elle est déjà là. Dans vos outils marketing. Vos logiciels RH. Vos CRM. Vos systèmes de recommandation. Parfois même… sans que vous sachiez vraiment où elle se cache.

Et quand une technologie commence à transformer l’économie pour de vrai, une autre mécanique se met en marche immédiatement :

👉 la régulation.

Entre l’entrée en application de l’AI Act européen, les crispations avec les États-Unis, les prises de position de l’ONU et les inquiétudes sur l’emploi, beaucoup de décideurs ont le même réflexe :

« On n’y comprend rien. Ça a l’air complexe. On verra plus tard. »

Mauvaise nouvelle : plus tard, c’est maintenant.

Bonne nouvelle : ce n’est ni aussi technique, ni aussi effrayant qu’on vous le raconte.

Chez l’Agence CIA Bourges, on voit tous les jours des entreprises bloquées non pas par la loi… mais par le flou.

Alors posons les bases, calmement, sans jargon inutile.

Dans cet article, vous allez comprendre :

- ce qu’est vraiment l’AI Act,

- pourquoi les États-Unis grincent des dents,

- ce que ça change concrètement pour l’emploi,

- et surtout quoi faire, sans devenir juriste ni data scientist.

L’AI Act : le nouveau cadre de jeu de l’intelligence artificielle en Europe

L’AI Act, entré en application en 2025, est la première loi au monde qui encadre l’intelligence artificielle de manière globale.

Et contrairement aux fantasmes, son principe est très simple :

👉 toutes les IA ne présentent pas les mêmes risques,

👉 donc elles ne doivent pas être régulées de la même façon.

L’Europe n’a pas dit :

« L’IA est dangereuse, on interdit. »

Elle a dit :

« Certaines IA sont sensibles. On va les regarder de plus près. »

Autrement dit : on ne traite pas un filtre photo comme un algorithme qui décide si quelqu’un obtient un crédit, un emploi ou un diagnostic médical.

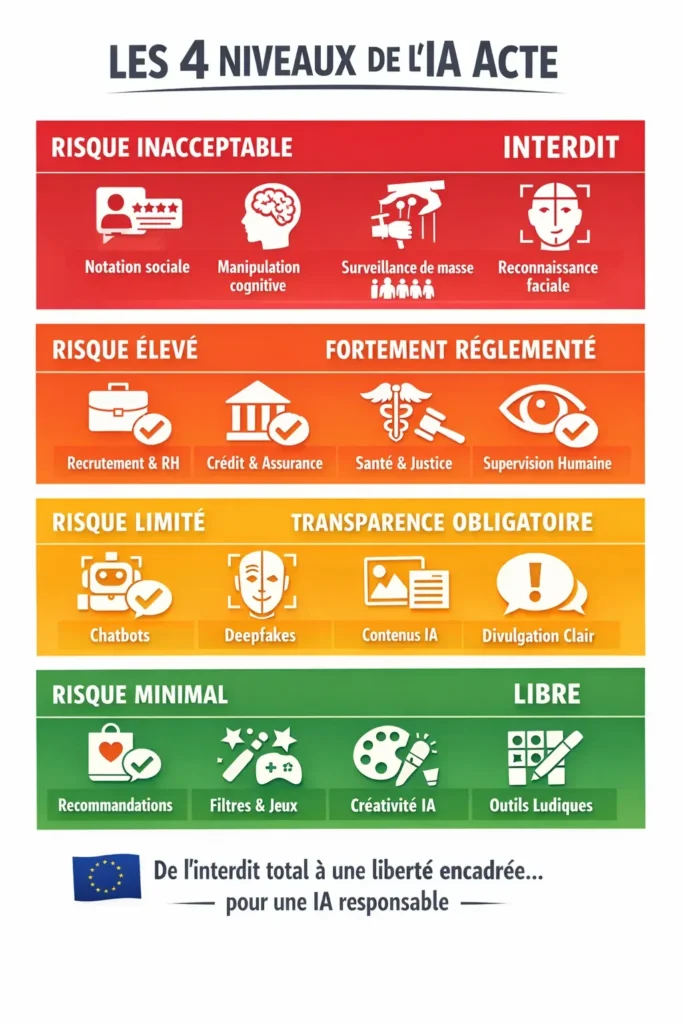

Les 4 niveaux de risque de l’AI Act (ce qu’il faut vraiment retenir)

🔴 Risque inacceptable → interdit

Usages incompatibles avec les droits fondamentaux :

- notation sociale généralisée,

- surveillance de masse intrusive,

- manipulation comportementale grave.

👉 Concrètement : aucune entreprise classique n’est concernée, sauf scénario dystopique.

🟠 Risque élevé → autorisé, mais très encadré

Ici, on parle des usages sensibles :

- recrutement et RH,

- accès au crédit ou à l’assurance,

- santé, éducation,

- justice, services publics critiques.

Pour ces usages, l’entreprise doit :

- documenter le système,

- garantir la qualité et la traçabilité des données,

- maintenir une supervision humaine réelle,

- pouvoir expliquer une décision contestée.

👉 L’IA assiste. Elle ne décide pas seule.

🟡 Risque limité → transparence obligatoire

Exemples :

- chatbot client,

- génération de texte ou d’image,

- assistant conversationnel.

Règle simple :

👉 l’utilisateur doit savoir qu’il interagit avec une IA.

🟢 Risque minimal → usage quasi libre

Tout ce qui relève de l’IA “de confort” :

- recommandations produits,

- automatisations internes,

- aide à la rédaction,

- optimisation logistique.

👉 Pas de contrainte lourde.

Ce que l’AI Act change vraiment pour une entreprise

Non, l’AI Act ne vous demande pas :

- d’embaucher un juriste à plein temps,

- de produire des dossiers de 200 pages,

- d’arrêter d’innover.

Il vous demande surtout :

- de savoir quelles IA vous utilisez,

- de comprendre pourquoi vous les utilisez,

- de garder un humain responsable dans la boucle.

Spoiler :

👉 beaucoup d’entreprises font déjà la moitié du travail… sans le savoir.

Les GPAI : les modèles d’intelligence artificielle à usage général

C’est quoi un GPAI, concrètement ?

Les GPAI (General Purpose AI) sont les grands modèles polyvalents :

- modèles de langage,

- IA génératives,

- moteurs capables d’être intégrés partout.

Ils sont la base de :

- chatbots,

- copilotes métiers,

- outils marketing,

- solutions SaaS intelligentes.

👉 Vous ne les entraînez pas. Vous les utilisez.

Pourquoi l’Europe s’y intéresse autant ?

Parce qu’un même modèle peut servir :

- à écrire une fiche produit,

- à analyser un CV,

- à résumer un dossier médical.

La Commission européenne a donc clarifié :

- les responsabilités des fournisseurs,

- le cycle de vie du modèle,

- la transparence attendue,

- les risques systémiques.

Ce que ça implique pour vous (bonne nouvelle)

Si vous êtes utilisateur, pas fournisseur :

- vous n’avez pas à documenter l’entraînement du modèle,

- mais vous devez maîtriser vos usages.

Exemple clair :

- rédiger une annonce → OK

- trier automatiquement des CV → zone à risque élevé

👉 Ce n’est pas l’outil qui est jugé, c’est l’usage.

États-Unis vs Europe : pourquoi ça frotte autant

Deux visions du monde numérique :

- 🇪🇺 Europe : cadre commun, droits fondamentaux, règles claires.

- 🇺🇸 États-Unis : innovation rapide, régulation a posteriori.

Quand l’Europe adopte l’AI Act, le DSA ou le DMA, Washington y voit :

- des contraintes,

- un impact direct sur les géants américains,

- une bataille d’influence mondiale.

👉 Derrière la régulation, il y a une guerre des standards.

Et pour les entreprises européennes ?

À court terme

- plus de vigilance,

- plus de clarté contractuelle.

À moyen terme

- avantage compétitif,

- confiance accrue des clients,

- réduction des risques juridiques.

Chez l’Agence de conseil en IA à Bourges, on le constate déjà :

👉 la conformité devient un argument commercial, pas un frein.

IA et emploi : sortir du fantasme

L’IA :

- automatise certaines tâches,

- transforme beaucoup de métiers,

- en crée de nouveaux.

Le vrai danger n’est pas l’IA.

👉 C’est l’absence de stratégie et d’accompagnement.

Le risque réel pour une entreprise :

- perdre des compétences,

- créer une fracture interne,

- automatiser sans gouvernance ni sécurité.

Former aujourd’hui, c’est rester compétitif demain.

Par où commencer quand on n’y connaît rien ?

Une feuille de route simple :

- Lister les outils IA utilisés (même indirectement).

- Identifier les usages sensibles.

- Choisir des fournisseurs transparents.

- Désigner un référent IA.

- Former les équipes.

👉 C’est exactement ce que fait une Agence CIA Bourges quand elle accompagne une organisation.

Conclusion : l’IA n’est pas le problème. L’improvisation, si.

L’AI Act, les tensions internationales et les débats sur l’emploi ne sont pas là pour freiner l’innovation.

Ils sont là pour éviter que l’intelligence artificielle devienne un facteur de risque incontrôlé.

L’objectif n’est pas d’être expert.

Mais d’être :

- informé,

- structuré,

- responsable.

Et bonne nouvelle : ceux qui s’y prennent tôt prennent toujours une longueur d’avance.

👉 Si vous voulez, cet article peut devenir :

- une fiche dirigeant,

- une check-list opérationnelle,

- un support de formation interne.

À la CIA, on appelle ça :

de l’IA utile. Pas magique. Mais maîtrisée.